I modelli linguistici avanzati (LLM) devono imparare continuamente, ma come gestiscono questa evoluzione senza dimenticare ciò che sanno e senza rompere la loro base di conoscenza? Il problema è che i metodi attuali spesso lasciano la conoscenza di iterazione come feedback testuale o memoria piatta, rendendo difficile mantenere un modello stabile durante l’inferenza.

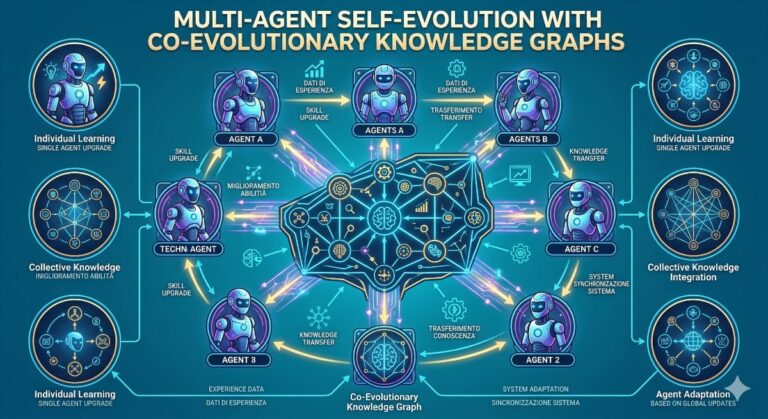

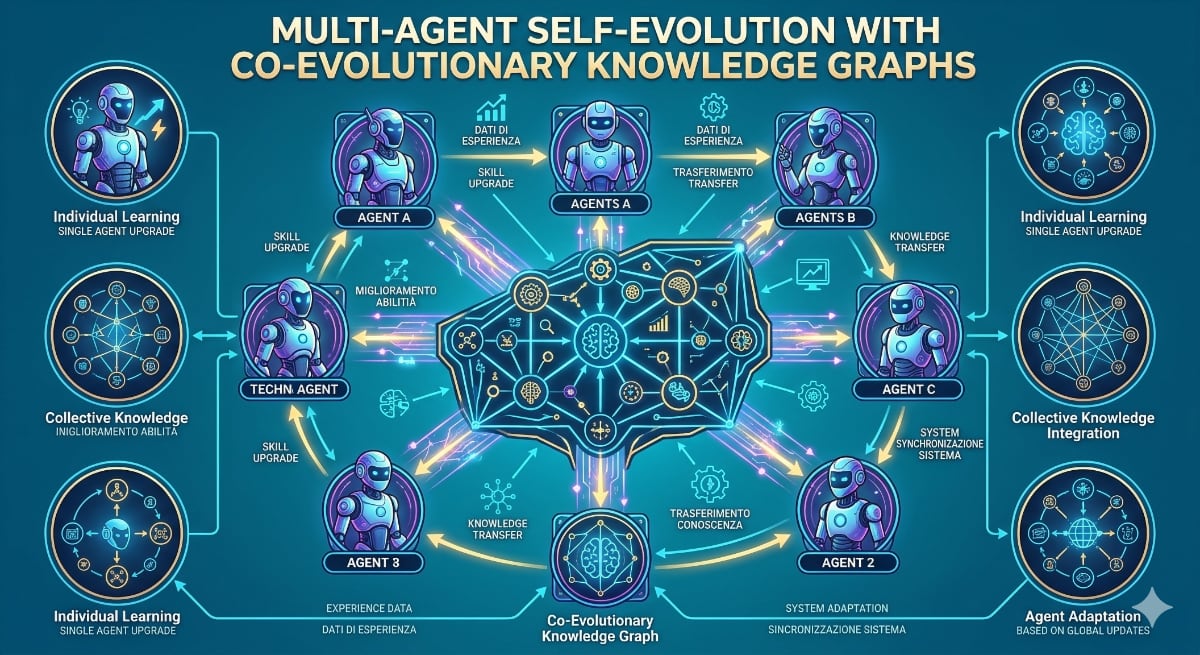

La ricerca introdotta da MAGE (Multi-Agent Graph-guided Evolution) affronta questa sfida creando un framework che permette agli agenti di apprendere in modo autonomo mantenendo al contempo una base di esecuzione (backbone) fissa e stabile. Invece di sovraccaricare il modello con la memoria, MAGE esternalizza la conoscenza in una struttura più organizzata: un grafo di conoscenza co-evolutivo.

Cosa cambia con il Knowledge Graph?

Immaginate la conoscenza del modello non come un mucchio di testo, ma come una mappa interconnessa. MAGE utilizza questo grafo per archiviare sia le correzioni fornite dai ‘maestri’ (feedback umani) sia i percorsi logici che gli agenti hanno seguito durante il loro ragionamento. Questo permette al sistema di recuperare la guida necessaria per eseguire compiti complessi, senza dover aggiornare costantemente il modello di base durante l’evoluzione.

Durante il processo di evoluzione, il grafo viene aggiornato in modo intelligente. Funziona come un ‘bandit’ di ricerca per le strategie di apprendimento e per la rotta delle competenze. Questo significa che l’evoluzione avviene sulla struttura della conoscenza (il grafo) mentre il motore di esecuzione sottostante rimane immutato, garantendo stabilità e affidabilità.

Perché è Importante ?

Questo approccio è cruciale per costruire sistemi AI più robusti, affidabili e capaci di apprendimento continuo. La capacità di separare il processo di apprendimento (l’evoluzione della conoscenza) dalla capacità di esecuzione (il backbone) è fondamentale per applicazioni enterprise dove la stabilità e la tracciabilità delle decisioni sono essenziali. I risultati su nove benchmark diversi, che spaziano dal ragionamento matematico all’analisi finanziaria e alla navigazione web, dimostrano che questa architettura porta a prestazioni superiori rispetto ai modelli basati su backbone congelati.

In sintesi, MAGE ci insegna come creare architetture dove la conoscenza è strutturata e gestita in modo esplicito, permettendo agli agenti di evolvere le loro capacità in modo sicuro e mirato. Siamo di fronte a un passo avanti nella creazione di LLM che non solo generano testo, ma che gestiscono attivamente la propria esperienza.

Per leggere il lavoro originale e i dettagli tecnici, si può consultare il paper su Hugging Face / arXiv: MAGE: Multi-Agent Self-Evolution with Co-Evolutionary Knowledge Graphs