Sbloccare la Velocità: Come il Decoding Speculativo Rivoluziona l’Inferenza LLM

L’inferenza di modelli linguistici di grandi dimensioni (LLM) è fondamentale per applicazioni moderne, ma la loro lentezza può rappresentare un collo di bottiglia significativo, specialmente nelle applicazioni in tempo reale. La ricerca recente sta esplorando metodi innovativi per superare questa limitazione, e il Decoding Speculativo emerge come una delle strategie più promettenti per rendere la generazione di testo più veloce ed efficiente.

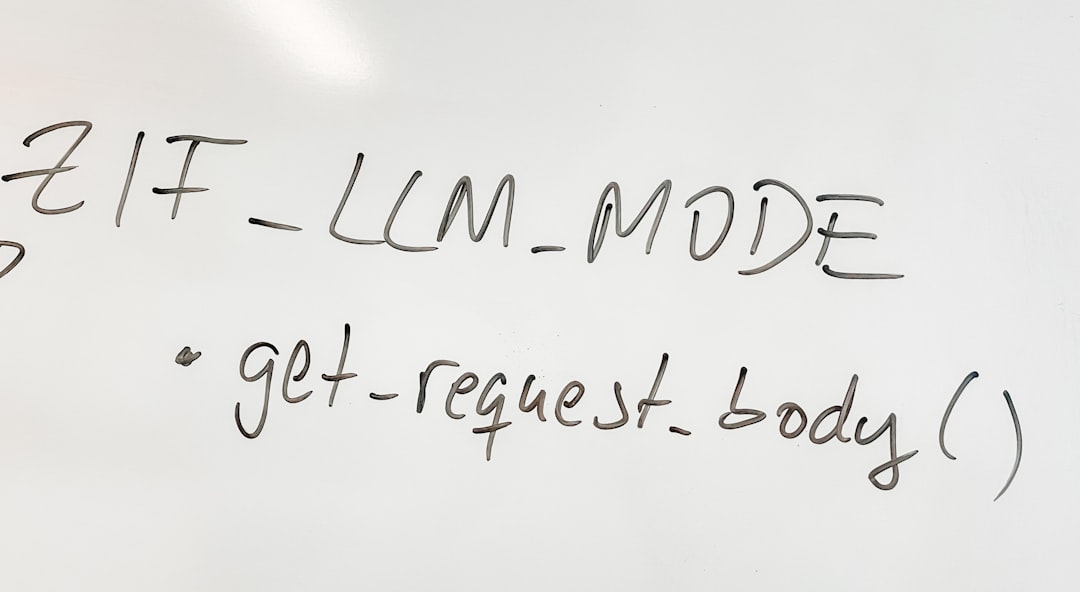

In termini pratici, il decoding speculativo non è solo una curiosità accademica; è una tecnica di ottimizzazione cruciale per sviluppatori e aziende che devono implementare LLM su hardware limitato o in ambienti ad alta latenza. L’idea di base è semplice: invece di generare un token alla volta in modo sequenziale (il metodo tradizionale), il modello genera in anticipo una ‘stima’ (una ipotesi speculativa) del testo futuro. Questo permette al sistema di pre-generare e verificare più possibili percorsi di generazione contemporaneamente, riducendo drasticamente il tempo di attesa.

Perché è Importante per lo Sviluppatore?

Per chi sviluppa sistemi basati su LLM, la velocità di inferenza si traduce direttamente in scalabilità e costi operativi. Implementazioni come EAGLE-3, Medusa-1 e PARD, non sono solo miglioramenti teorici, ma rappresentano architetture pratiche per ottimizzare il processo di decodifica. Permettono di sfruttare meglio le capacità del hardware e di ridurre la latenza percepita dagli utenti.

La ricerca sta anche esplorando metodi più fondamentalmente basati su stringhe, come il N-gram e il Suffix Decoding, che permettono di costruire strategie di decodifica più intelligenti partendo da pattern linguistici preesistenti. Questo sposta il focus dalla pura capacità del modello alla strategia di generazione più efficiente.

Implicazioni Future

Queste implementazioni dimostrano che esiste un ampio spazio di miglioramento nell’ottimizzazione dell’inferenza. Per le aziende, significa poter deployare modelli più grandi e complessi con una latenza accettabile, aprendo la strada a nuove applicazioni in tempo reale come chatbot avanzati, sintesi vocale veloce e sistemi di generazione di codice ottimizzati. La comunità sta lavorando per trasformare queste idee in librerie e framework pronti all’uso per il mondo reale.