Raggiungere il Limite del Contesto: LLM più grandi su Hardware Consumer

Il collo di bottiglia principale nello sviluppo e nell’implementazione di Large Language Models (LLM) è spesso la gestione della finestra di contesto (context window). Tradizionalmente, aumentare la dimensione del contesto richiede enormi quantità di VRAM o costosi processi di riaddestramento (retraining), rendendo l’esplorazione di modelli con finestre molto ampie inaccessibile per molti sviluppatori e aziende.

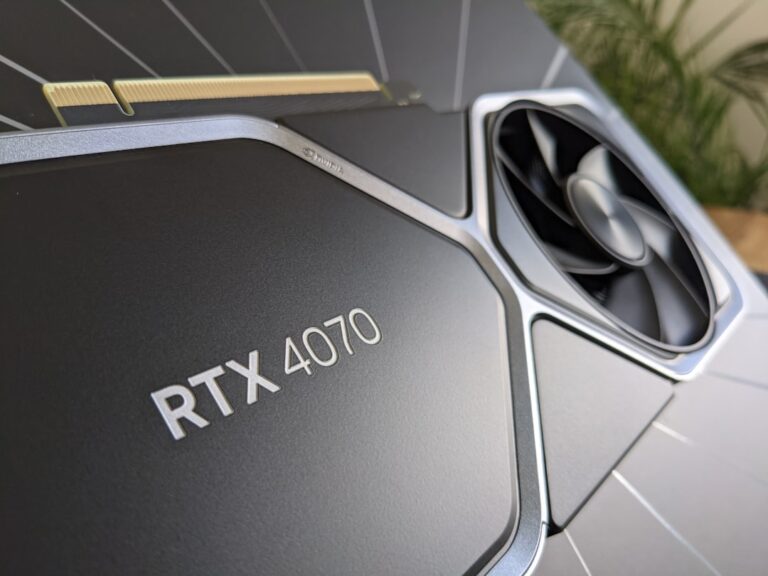

Una recente innovazione, spesso discussa nelle comunità di Machine Learning, ha dimostrato come superare questa limitazione. Si è ottenuto il risultato di estendere la finestra di contesto fino a 1 milione di token su hardware consumer come la RTX 4070 (12GB VRAM), senza la necessità di un costoso riaddestramento del modello.

Perché è una svolta per gli Sviluppatori?

Questo non è solo un trucco tecnico; è un cambiamento di paradigma per l’inferenza locale. Il punto cruciale è che il risultato è stato ottenuto tramite una tecnica di sostituzione della cache HuggingFace (cache replacement) che è ‘drop-in’, ovvero funziona immediatamente con qualsiasi modello che utilizza la tecnica DynamicCache. Questo significa che gli sviluppatori non devono riscrivere interi pipeline di addestramento per gestire finestre di contesto massime; possono semplicemente applicare questa ottimizzazione per sfruttare al massimo la memoria disponibile sulla GPU.

In termini pratici, questo riduce drasticamente la barriera d’ingresso per eseguire esperimenti avanzati con modelli molto grandi (Long Context) direttamente sul proprio hardware, promuovendo l’efficienza e la personalizzazione dei modelli in ambienti di edge computing o server locali.

Implicazioni per l’Ingegneria del Software

Per le aziende e i professionisti tech, questa ricerca sottolinea la necessità di ottimizzare l’architettura di inferenza. Invece di affidarsi esclusivamente alla capacità bruta della VRAM, l’attenzione si sta spostando su come la memoria viene gestita e riutilizzata durante il processo di generazione. L’ottimizzazione della cache e del contesto diventa una leva fondamentale per rendere l’IA più accessibile e performante sul hardware disponibile.

Sebbene il paper originale sia spesso condiviso in forum come Reddit, l’implicazione è chiara: le tecniche di ottimizzazione della memoria e del caching stanno diventando il campo di battaglia per sbloccare il potenziale dei modelli di linguaggio su hardware meno potenti. Resta da vedere come questa tecnica si integrerà nei framework standard per l’inferenza LLM.